علیرغم بحثها در مورد توانایی واقعی هوش مصنوعی مولد یا به اختصار (LLM)، این فناوری پتانسیل زیادی برای تغییر نحوه زندگی و کار ما دارد. رهبران فناوری اطلاعات که میخواهند از این فناوری بهره ببرند، باید مسائل زیر را در نظر داشته باشند. در این مقاله سعی میکنیم ۷ راز در مورد هوش مصنوعی مولد را مورد بررسی قرار دهیم.

برخی از نگرانیها در مورد هوش مصنوعی مولد عبارتند از:

- عدم دقت: الگوریتمهای هوش مصنوعی مولد هنوز هم میتوانند اشتباه کنند. به عنوان مثال، ممکن است تصاویر یا متنی ایجاد کنند که نادرست یا گمراه کننده باشد.

- تعصب: الگوریتمهای هوش مصنوعی مولد میتوانند متأثر از همان تعصبهایی باشند که در دادههای آموزشی آنها وجود دارد. این میتواند منجر به ایجاد محتوای تبعیضآمیز یا مضر شود.

- سوء استفاده: هوش مصنوعی مولد میتواند برای ایجاد محتوای مخرب یا تبلیغاتی استفاده شود.

قیمت سهام شرکتهای مرتبط با هوش مصنوعی در حال افزایش است. این فناوری به سرعت در حال پیشرفت است و تواناییهای آن غیرقابل انکار است. با این حال، مهم است که به یاد داشته باشید که هوش مصنوعی مولد هنوز در مراحل اولیه خود است و هنوز هم معایبی دارد.

هنگام برنامهریزی برای استفاده از هوش مصنوعی مولد در کسبوکار خود، مهم است که این خطرات را در نظر داشته باشید. اقداماتی را برای کاهش خطرات و اطمینان از استفاده ایمن و مسئولانه از این فناوری اتخاذ کنید.

هوش مصنوعی مولد: چگونه از خطاها جلوگیری کنیم ؟

مدلهای زبانی بزرگ (LLM) در نوشتن مقالات 1000 کلمهای در مورد موضوعات مبهم مهارت خارقالعادهای دارند. آنها میتوانند اطلاعاتی را ارائه دهند که به طور باورنکردنی دقیق و آموزنده است. با این حال، همین قدرت آنها را قادر میسازد تا اشتباهاتی را به راحتی مرتکب شوند. آنها ممکن است افعال مختلف را به روشهای غیرمرسوم ترکیب کنند، گرامر را اشتباه اعمال کنند، یا اطلاعات نادرست ارائه دهند. در نتیجه، ممکن است متنی تولید کنند که برای یک دانشآموز ابتدایی نیز غیرقابل قبول باشد. این یک راز مهم در مورد هوش مصنوعی مولد است و تا زمانی که با آن کار نکنید متوجه آن نخواهید شد.

این چالش ها می تواند شامل موارد زیر باشد:

- تعیین اینکه کدام اطلاعات باید طبقه بندی شوند و در چه سطحی

- مدیریت دسترسی به اطلاعات طبقه بندی شده

- اطمینان از اینکه اطلاعات طبقه بندی شده به طور ایمن ذخیره و محافظت می شوند

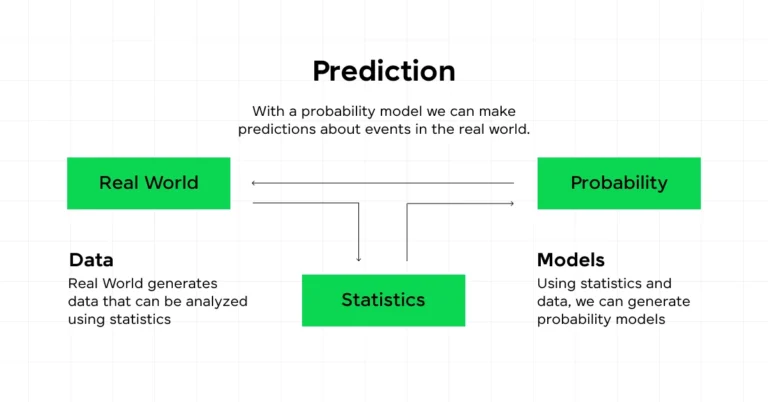

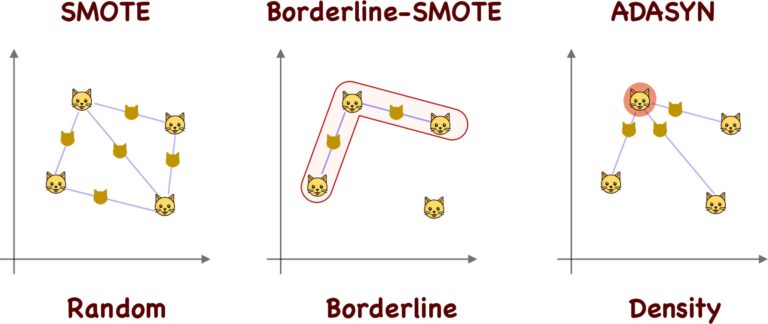

آنها از احتمالات برای یادگیری ترکیب کلمات استفاده می کنند، اما این بدان معناست که آنها گاهی اوقات کلمات اشتباهی را انتخاب می کنند. آنها هیچ دانش یا بینشی در مورد جهان ندارند که آنها را هدایت کند، بنابراین این فقط شانس است که آنها متنی تولید کنند که دقیق یا آموزنده باشد.

هوش مصنوعی مولد بخشی از اطلاعات را فیلتر میکند

انسان ها همواره تلاش کرده اند تا دانش خود را به صورت طبقه بندی شده و سلسله مراتبی سازماندهی کنند. در این سلسله مراتب، برخی از اطلاعات تنها برای افراد خاصی قابل دسترسی است، در حالی که برخی دیگر برای همه قابل دسترسی است. این سلسله مراتب در سیستمهای طبقه بندی نظامی به وضوح قابل مشاهده است، اما بسیاری از کسب و کارها نیز از آن استفاده می کنند.

حفظ این سلسله مراتب برای بخش فناوری اطلاعات و CIOهایی که آنها را مدیریت می کنند، اغلب یک چالش است.

کامپیوترها پیروان نهایی قوانین هستند و می توانند کاتالوگ های پیچیده ای را نگه دارند، راز بعدی در مورد هوش مصنوعی مولد این است که آنها به طور ذاتی برای حفظ اطلاعات طبقه بندی شده طراحی نشده اند. آنها فقط مجموعه ای عظیمی از احتمالات هستند که می توانند تصادفی به هم پیوسته شوند.

در نتیجه، LLM ها گاهی اوقات می توانند اطلاعات طبقه بندی شده را فاش کنند.

به همین دلیل، آنها اغلب با اطلاعاتی آموزش داده می شوند که عمومی هستند و در صورت فاش شدن مشکلی ایجاد نمی کنند. با این حال، حتی این اطلاعات نیز می توانند توسط LLM ها فاش شوند، همانطور که در چندین نمونه با مشخصات بالا مشاهده شده است.

با این حال، هنوز زمان زیادی طول می کشد تا بهترین راه برای انجام این کار مشخص شود. تا آن زمان، CIO ها باید اقدامات احتیاطی بیشتری انجام دهند تا از فاش شدن اطلاعات طبقه بندی شده محافظت کنند.

از رازهای استفاده از هوش مصنوعی مولد تنبل شدن است !

زیاده روی در استفاده و اعتماد به کامپیوترها و هوش های ماشینی انسانها را تنبل میکند.

انسان ها در اعتماد به کامپیوترها ها بسیار خوب هستند، به خصوص اگر این کار باعث صرفه جویی در وقت و تلاش آنها شود. هنگامی که LLM ها ثابت می کنند که اکثر اوقات درست هستند، انسان ها به سرعت شروع به اعتماد به آنها می کنند.

این تنبلی می تواند خطرناک باشد. حتی درخواست از انسان برای بررسی مجدد هوش مصنوعی نیز چندان کارساز نیست. بعد از اینکه انسان ها به درستی هوش مصنوعی عادت کردند، شروع به دور زدن آن می کنند و صرفاً به آن اعتماد می کنند که درست باشد.

این تنبلی می تواند به سرعت در یک سازمان گسترش یابد. انسان ها از فکر کردن برای خود دست می کشند و در نهایت شرکت در یک سکون کم انرژی فرو می رود، جایی که هیچ کس نمی خواهد خارج از چارچوب فکر کند. این می تواند برای مدتی آرامش بخش و بدون استرس باشد، اما در نهایت، این سکون باعث می شود شرکت در برابر رقابت آسیب پذیر شود.

هزینههای پنهان استفاده از هوش مصنوعی مولد

یک راز دیگر درباره هوش مصنوعی مولد این است که هزینه استفاده از آنها به طور دقیق مشخص نیست. بسیاری از API ها هزینه هر توکن را مشخص می کنند، اما این هزینه ممکن است توسط سرمایه گذاران خطر پذیر پذیر پرداخت شود. این موضوع را می توان با مقایسه آن با خدماتی مانند اوبر مشاهده کرد که در ابتدا قیمت های پایینی ارائه می دادند تا زمانی که پول سرمایه گذاران آن تمام شد و سپس قیمت ها افزایش یافت.

نشانه هایی وجود دارد که هزینه های فعلی LLM ها پایدار نیست. اجاره یک کارت گرافیک خوب و راه اندازی آن می تواند بسیار گران تر باشد. حتی اگر بتوانید با اجرای LLM های خود به صورت محلی هزینه ها را کاهش دهید، تمام مزایای خدمات کلید در دست مانند پرداخت فقط برای زمانی که به آنها نیاز دارید را از دست می دهید.

می توانند حقوق مالکیت معنوی را نقض کنند

LLM ها ابزارهای قدرتمندی هستند که می توانند طیف وسیعی از کارها را انجام دهند. با این حال، استفاده از آنها در کسب و کار چالش هایی را به همراه دارد.

یکی از چالش ها این است که LLM ها معمولاً برای کارهای عمومی طراحی شده اند. آنها برای کارهای خاص یک کسب و کار به اندازه کافی سفارشی نیستند. برای سفارشی کردن LLM ها، شرکت ها باید داده های آموزشی خود را فراهم کنند.

جمع آوری داده های آموزشی چالش برانگیز است. شرکت ها باید اطمینان حاصل کنند که داده ها قانونی و اخلاقی هستند. آنها همچنین باید فرم های قانونی مناسب را برای استفاده از داده ها دریافت کنند.

چالش دیگر استفاده از LLM ها در کسب و کار مسائل مربوط به حق چاپ و حریم خصوصی است. شرکت ها باید اطمینان حاصل کنند که از داده های دیگران بدون مجوز استفاده نمی کنند. آنها همچنین باید از حریم خصوصی مشتریان خود محافظت کنند.

عدم ارزیابی گزینه های جایگزین

در تئوری، الگوریتمهای هوش مصنوعی قرار است مستقل و انعطافپذیر باشند. این بدان معناست که باید بتوان آنها را به راحتی با فروشندههای مختلف سازگار کرد. با این حال، در واقعیت، هنوز تفاوتهایی بین API های مختلف وجود دارد.

این تفاوتها میتواند در ساختارهای JSON فراخوانی، یا حتی در نحوه عملکرد هوش مصنوعی در زیرمجموعههای خاص دادهها باشد. این تفاوتها میتواند نوشتن اعلانهای مناسب برای هوش مصنوعی را دشوار کند، که میتواند منجر به عملکرد ضعیف یا حتی شکست شود.

در نتیجه،تغییر سریع شرکت ارائه دهنده خدمات هوش مصنوعی همیشه آسان نیست. این یک چالش مهم است که باید در نظر گرفته شود، به خصوص در سازمانهایی که به دنبال استفاده از هوش مصنوعی برای بهبود عملیات خود هستند.

هوش آنها به اندازه کافی توسعه نیافته است.

شکاف بین آشنایی سطحی و درک عمیق، موضوعی است که از دیرباز در دانشگاه ها مورد بحث بوده است. الکساندر پوپ در سال 1709 نوشت: «آموزش اندک چیز خطرناکی است. عمیق بنوشید یا چشمه پیریان را نچشید.»

سایر افراد باهوش نیز محدودیت های هوش انسانی را مشاهده کرده اند. سقراط به این نتیجه رسید که با تمام دانشش، او واقعاً چیزی نمی دانست. شکسپیر فکر می کرد که مرد عاقل خود را احمق می داند.

این بینش ها در مورد هوش مصنوعی مولد نیز اعمال می شود. هوش مصنوعی مولد می تواند اطلاعات زیادی تولید کند، اما این اطلاعات همیشه دقیق یا مفید نیست. مدیران ارشد فناوری و تیم های رهبری فناوری باید مراقب باشند که از هوش مصنوعی مولد به طور مسئولانه استفاده کنند. آنها باید از بهترین چیزهایی که هوش مصنوعی مولد می تواند تولید کند، استفاده کنند، در حالی که از خطرات بالقوه آن نیز آگاه باشند.