شرکت فناوری علیبابا به تازگی از نسل سوم مدلهای هوش مصنوعی خود با نام مدل Qwen3 235B که گامی مهم در توسعه مدل های زبانی بزرگ است و توانایی های قابل توجهی در پردازش زبان طبیعی، استدلال و حل مسائل پیچیده نشان می دهد. پرده برداشته است. این مجموعه مدل با هدف رقابت جدی و حتی پیشی گرفتن از برترین مدلهای موجود در بازار، شامل محصولات شرکتهایی نظیر OpenAI و گوگل، معرفی شده است. در میان این مدلها، Qwen3 235B به عنوان پرچمدار این سری خودنمایی میکند. این مدل با داشتن ۲۳۵ میلیارد پارامتر که ۲۲ میلیارد آن در هر لحظه فعال هستند، به عنوان یک مدل هوش مصنوعی ترکیبی استدلالی شناخته میشود که تواناییهای بینظیری در پردازش دادهها و ارائه پاسخهای دقیق از خود نشان میدهد.

معرفی مدل Qwen3 235B

مدل Qwen3 235B جدیدترین نسل از خانواده مدل های زبانی Qwen است که شرکت علی بابا، آن را توسعه داده است. این مدل با 235 میلیارد پارامتر، بزرگترین مدل عمومی خانواده Qwen به شمار می رود و در بسیاری از معیارهای ارزیابی، عملکرد قابل توجهی از خود نشان می دهد.

مدل Qwen3 235B از یک معماری پیشرفته به نام Mixture of Experts (MoE) بهره میبرد. در این نوع معماری، وظایف پیچیده بین چندین مدل کوچکتر و تخصصی تقسیم میشوند. این رویکرد باعث میشود تا کارایی محاسباتی افزایش یابد و سرعت پاسخگویی مدل بهبود پیدا کند. Qwen3 235B دارای مجموعاً ۲۳۵ میلیارد پارامتر است، اما در هر مرحله از پردازش، تنها ۲۲ میلیارد پارامتر آن به صورت فعال درگیر میشوند. این روش به مدل این امکان را میدهد که با صرف هزینه محاسباتی به مراتب کمتر، عملکردی قابل رقابت با مدلهای بسیار بزرگتر از خود نشان دهد.

مشخصات فنی مدل Qwen3 235B

- تعداد پارامترها: 235 میلیارد

- معماری: ترانسفورمر با بهینه سازی های اختصاصی

- زبان های پشتیبانی شده: بیش از 100 زبان با تمرکز ویژه بر انگلیسی و چینی

- حافظه زمینه (Context Window): 128K توکن

- روش آموزش: ترکیبی از آموزش نظارت شده و هم راستاسازی با بازخورد انسانی (RLHF)

- دسترسی: اوپن سورس با مجوز Tongyi Qwen License

عملکرد Qwen3 235B در بنچمارک های مختلف

مدل Qwen3 235B در آزمون های مختلف عملکرد چشمگیری داشته است. در ادامه به برخی از نتایج کلیدی اشاره می کنیم:

MMLU (بنچمارک چند وظیفه ای دانش عمومی)

- Qwen3 235B: 82.3%

- Claude 3 Opus: 86.8%

- GPT-4: 86.4%

- Gemini Ultra: 83.7%

در این بنچمارک که دانش عمومی و استدلال را می سنجد، Qwen3 235B عملکرد قابل قبولی دارد، اگرچه هنوز با برترین مدل ها فاصله دارد.

HELM (بنچمارک جامع ارزیابی مدل های زبانی)

در بنچمارک HELM که 57 وظیفه متنوع را شامل می شود، Qwen3 235B توانسته است در برخی دسته ها از مدل های بزرگتر مانند PaLM 540B پیشی بگیرد.

MMLU-Pro (نسخه پیشرفته بنچمارک MMLU)

این بنچمارک که سوالات پیچیده تری را مطرح می کند:

- Qwen3 235B: 67.1%

- Claude 3 Opus: 71.6%

- GPT-4: 69.3%

GSM8K (حل مسائل ریاضی)

- Qwen3 235B: 89.3%

- Claude 3 Opus: 97.6%

- GPT-4: 92.0%

در حل مسائل ریاضی، Qwen3 235B عملکرد خوبی دارد اما هنوز تا مدل های برتر فاصله دارد.

مقایسه مدل Qwen3 235B با رقبای اصلی

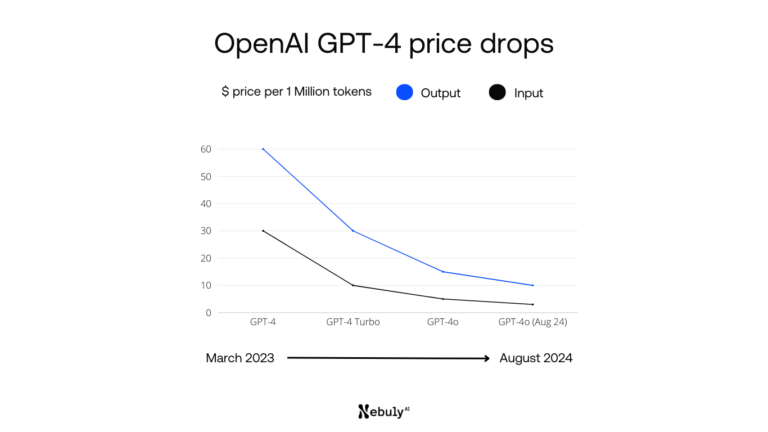

مقایسه با GPT-4 و GPT-4o

مدل هوش مصنوعی GPT-4 و نسخه جدید آن GPT-4o، همچنان از پیشگامان صنعت هوش مصنوعی هستند. Qwen3 235B در برخی آزمون های تخصصی مانند استدلال های کدنویسی چینی و پردازش مسائل مربوط به فرهنگ آسیایی عملکرد بهتری نشان می دهد، اما در بیشتر آزمون های عمومی هنوز GPT-4 برتری دارد.

مقایسه با Claude 3 Opus

مدل هوش مصنوعی Claude 3 Opus از Anthropic با امتیازات بالاتر در بسیاری از بنچمارک ها مانند MMLU و GSM8K، عملکرد بهتری نسبت به Qwen3 235B نشان می دهد. با این حال، Qwen3 235B در پردازش زبان های آسیایی و مسائل چندزبانه دقت بیشتری دارد.

مقایسه با Gemini 2.5 Pro

مدل های Gemini از گوگل در مسائل چندمدالی (ترکیب متن، تصویر، صدا) عملکرد بهتری دارند، اما Qwen3 235B در تحلیل های عمیق متنی به خصوص در زبان چینی، موفق تر عمل می کند.

مقایسه با LLaMA 3 70B و 400B

مدل Qwen3 235B در مقایسه با LLaMA 3 70B عملکرد بهتری در بیشتر بنچمارک ها نشان می دهد. اما Meta اخیراً از توسعه LLaMA 3 400B خبر داده که احتمالاً رقابت جدی برای Qwen3 235B خواهد بود.

نقاط قوت و ویژگی های برجسته Qwen3 235B

چندزبانه بودن قوی

مدل Qwen3 235B بر خلاف بسیاری از مدل های غربی، توجه ویژه ای به زبان های آسیایی مانند چینی، ژاپنی و کره ای دارد و در این زمینه عملکرد بهتری نشان می دهد.

توانایی استدلال پیچیده

این مدل توانایی قابل توجهی در استدلال زنجیره ای (Chain-of-Thought) و حل مسائل پیچیده نشان می دهد که آن را برای کاربردهای علمی و تجاری مناسب می سازد.

بهینه سازی برای کاربردهای عملی

علی بابا این مدل را با تمرکز بر کاربردهای واقعی و حل مسائل تجاری توسعه داده است، بنابراین در وظایف عملی مانند خلاصه سازی متون طولانی، استخراج اطلاعات از داده های بزرگ و پاسخگویی به پرسش های پیچیده عملکرد خوبی دارد.

حافظه زمینه بزرگ

با حافظه زمینه 128K توکن، این مدل می تواند متون بسیار طولانی را پردازش کند و استدلال های پیچیده با داده های گسترده انجام دهد.

کاربردهای مدل Qwen3 235B در صنایع مختلف

هوش تجاری و تحلیل داده

مدل هوش مصنوعی Qwen3 235B با توانایی پردازش متون طولانی و استخراج اطلاعات کلیدی، برای تحلیل گزارش های کسب و کار، داده های بازار و تهیه خلاصه های مدیریتی بسیار مناسب است.

کدنویسی و توسعه نرم افزار

توانایی های کدنویسی این مدل در زبان های برنامه نویسی مختلف، آن را ابزاری کارآمد برای توسعه دهندگان در نوشتن، دیباگ و بهینه سازی کد می سازد.

پژوهش علمی

قدرت استدلال و توانایی پردازش متون علمی پیچیده، Qwen3 235B را به ابزاری مفید برای محققان تبدیل کرده است که می تواند در تحلیل مقالات، پیشنهاد فرضیه های جدید و طراحی آزمایش ها کمک کند.

پردازش زبان طبیعی چندزبانه

با پشتیبانی قوی از بیش از 100 زبان، این مدل برای کاربردهای جهانی مانند ترجمه، تولید محتوا و تحلیل احساسات در زبان های مختلف مناسب است.

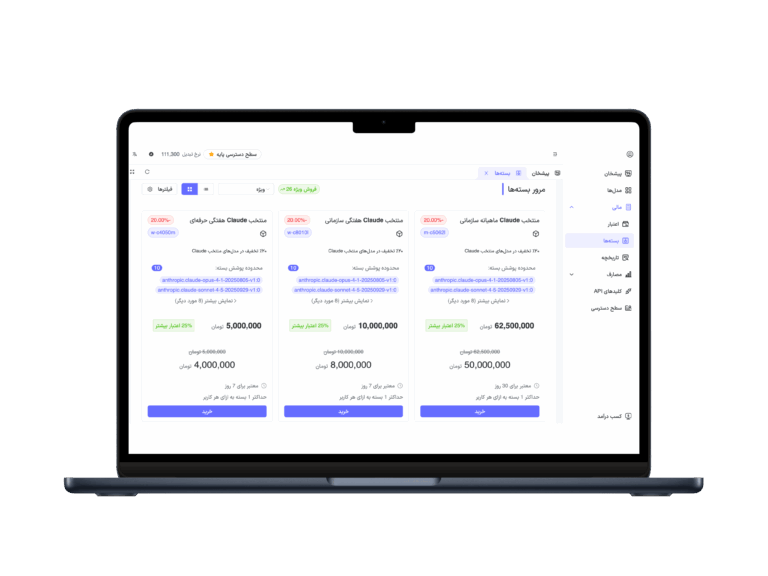

دسترسی به مدل Qwen3 235B در پلتفرم AvalAI

خبر مهم دیگر اینکه Qwen3 235B اخیراً به پلتفرم AvalAI اضافه شده است. کاربران می توانند از این مدل هم در بخش گفتگوها و هم در بخش توسعه دهندگان استفاده کنند. این ادغام، امکانات جدیدی را برای کاربران AvalAI فراهم می کند تا از قدرت این مدل عظیم در پروژه های خود بهره ببرند.

توسعه دهندگان می توانند از API های Qwen3 235B برای ساخت اپلیکیشن های هوشمند استفاده کنند، و کاربران عادی نیز می توانند با این مدل در محیط گفتگوی AvalAI تعامل داشته باشند.

چالش ها و محدودیت های Qwen3 235B

نیازمندی های سخت افزاری بالا

اجرای مدلی با 235 میلیارد پارامتر به منابع محاسباتی عظیمی نیاز دارد که استفاده از آن را برای بسیاری از کاربران و شرکت های کوچک دشوار می سازد.

توهمات هوش مصنوعی

مانند سایر مدل های زبانی بزرگ، Qwen3 235B نیز گاهی اطلاعات نادرست تولید می کند یا به “توهمات هوش مصنوعی” دچار می شود.

چالش های اخلاقی و امنیتی

قدرت بالای این مدل در تولید محتوا، چالش های جدی در زمینه امنیت سایبری، انتشار اطلاعات نادرست و سوءاستفاده های احتمالی ایجاد می کند.

آینده مدل Qwen و رقابت مدل های زبانی

با معرفی Qwen3 235B، رقابت در عرصه مدل های زبانی بزرگ شدت گرفته است. شرکت های مختلف در حال توسعه مدل های بزرگتر با قابلیت های پیشرفته تر هستند:

- Meta با توسعه LLaMA 3 400B

- Google با توسعه نسل بعدی Gemini

- OpenAI با توسعه GPT-5

- Anthropic با توسعه نسل بعدی Claude

این رقابت احتمالاً منجر به پیشرفت های چشمگیر در زمینه قابلیت های استدلال، درک زبان طبیعی و حل مسائل پیچیده خواهد شد.

نتیجه گیری

مدل Qwen3 235B گامی مهم در توسعه مدل های زبانی بزرگ است که توانایی های قابل توجهی در پردازش زبان طبیعی، استدلال و حل مسائل پیچیده نشان می دهد. این مدل با 235 میلیارد پارامتر، از معدود مدل های اوپن سورس در این مقیاس است که برتری هایی به خصوص در پردازش زبان های آسیایی نشان می دهد.

اگرچه Qwen3 235B در برخی بنچمارک ها هنوز با برترین مدل های تجاری مانند GPT-4 و Claude 3 Opus فاصله دارد، اما دسترس پذیری و قابلیت های چندزبانه آن، این مدل را به گزینه ای جذاب برای بسیاری از کاربردها تبدیل کرده است.

با افزوده شدن این مدل به پلتفرم AvalAI، کاربران بیشتری می توانند از توانایی های پیشرفته آن بهره ببرند و شاهد کاربردهای نوآورانه این فناوری در آینده نزدیک خواهیم بود.